“10天受益3000+,纯软件生成,小白可做”“用大模型7分钟写了9篇短篇小说,都签约了”“下班后借助大模型搞虚拟资料,半个月自动接了750单”……打开社交平台,诸如此类的宣传语随处可见。有没有想过,网络上的爆款文章、热点视频,有相当一部分并非出自真人之手。更重要的是,由AI批量生产的“工业制品”中,相当一部分违背事实,通过造谣的方式博取关注度,获得收益。

社交平台有大量鼓吹AI副业赚钱的帖子(网络截屏)

社交平台有大量鼓吹AI副业赚钱的帖子(网络截屏)

记者历时半个多月调查发现,一条涵盖AI内容生成、教程售卖、流量裂变、商业变现的完整造假产业链已悄然形成,不仅误导普通网民,更对正常的网络传播秩序和商业环境造成冲击。

一键“二创”,AI裂变

从各地网信部门和公安部门披露的案例看,使用AI大模型生成文字、视频造谣,已经不再稀奇。其实,在整条造假产业链上,用AI生成谣言,只是起点。

具体来看,整条产业链涉及不同的盈利方式,最常见的一种是造假者利用自媒体矩阵,发布大量AI造假内容,为自己增加关注度,既能通过平台的流量分成机制或植入广告获利,又能利用关注度推销自己的服务。

同时,大量企业或个人在推销“AI教程”。他们深谙平台流量和广告分配机制,继而开发出对应的“AI生成课程”以及相关服务,通过销售课程和生成服务,也能牟利。

MCN等经纪机构也成为产业链中的一环,有的指导旗下账号通过AI生成获益,有的为相关账号对接“市场需求”——只是部分需求并不那么光彩,包括抹黑部分企业、行业乃至知名人士的“小黑稿”。

这些盈利方式各有特点又互相交织,核心都是“AI造假”。在实际生活中,一条谣言的诞生和传播,往往穿插着不同的利益链条。

典型案例是近期被宁波市餐饮业与烹饪协会辟谣的“宁波外卖商家集体下架平台”消息。

溯源显示,最初传出“宁波外卖商家集体下架”消息的是一个以推销课程为主要内容的短视频账号。之所以一个账号发布的内容会快速发酵成话题,是因为该账号并非“孤军战斗”,而是有20多个与其名称相类似的账号发布了总共约40余条相似内容的消息。它们共同构成本轮谣言源头。而在这40余条消息中,有相当一部分使用了AI生成的文字和图片。

进一步核查发现,这20多个账号背后的主体是同一家公司,其主营业务是提供服务培训,通俗地说,就是“卖课”。该公司旗下共有超过200个社交平台账号。综观这些账号发布的内容可见,主要运营方式是发布各种消息吸引流量后,由账号主播兜售培训课程。

“宁波外卖商家集体下架”的假消息进一步扩散传播,还来自一堆账号“助推”。追溯发现,在第一组假消息出现后一周内,由AI创作的相关文字和图片内容开始在各个社交平台出现,不同形式的“二创”谣言超过100条;一周后,更是出现了“山西忻州外卖集体下架”的谣言变体。

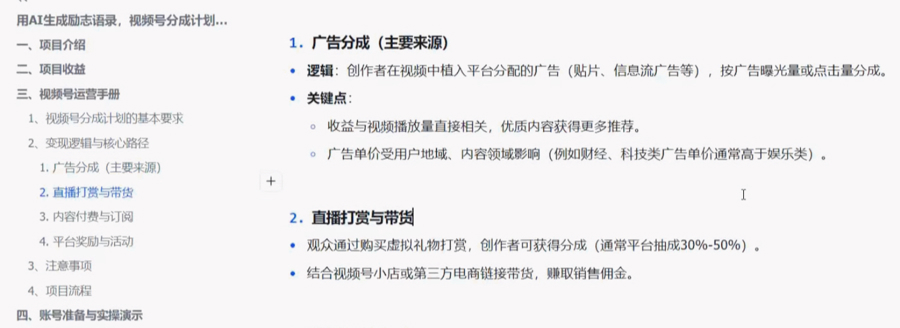

通过“眼球效应”到底能赚多少钱?记者通过社交平台购买了一套声称“10天受益3000元”的“视频号AI生成励志语录保姆级教程”。下单后,记者收到对方发送的网盘链接,其中介绍了如何将他人发布的心灵鸡汤去除水印、用AI生成图片视频进行二创的方法,表示只要用对工具,每天可以生成数百条。至于“10天受益3000元”,靠的是平台的植入广告分成机制、直播带货和微店销售,主要来源是广告分成。

记者购买的“AI教程”部分内容截图

记者购买的“AI教程”部分内容截图

知情人士更是为记者算了一笔细账:且不说相关账号利用关注度推销自身产品或服务的盈利,单从社交平台提供的流量分成与植入广告收入看,就很可观。

以某社交平台的植入广告分配制度为例,一个拥有1000粉丝、单篇阅读量1000的视频账号,如果支持植入广告,根据账号定位、内容是否为原创、植入广告数量及位置等,单篇广告收入从十几元到上千元不等。“不要小看十几元,因为对那些靠吸引眼球牟利的企业来说,旗下有数百上千个账号。所以,同一主题,用AI写出不同角度、不同细节的文章,都能被平台认定为‘原创’,继而获得相对较高的广告收入。综合起来看,一条谣言就有可能获得数千元收入。”该人士提醒。

爆款有“教程”,造假有“选题”

有人靠AI赚钱,也有人教他人用AI赚钱,还有人发布“需求”,暗地里支持AI造假牟利。

在多个社交平台和知识付费平台上,“AI爆款写作秘籍”“零基础玩转AI文案”等教程随处可见,价格从十几元到数千元不等;甚至有账号表示免费赠送AI教程。

记者在某社交平台联系了一个声称免费赠送“AI副业”教程的账户。对方将记者引入一个“AI写作群”,推销了其所属企业开发的AI写作网站。使用该网站按字数付费,目前的优惠价是9.9元可生成10万字。

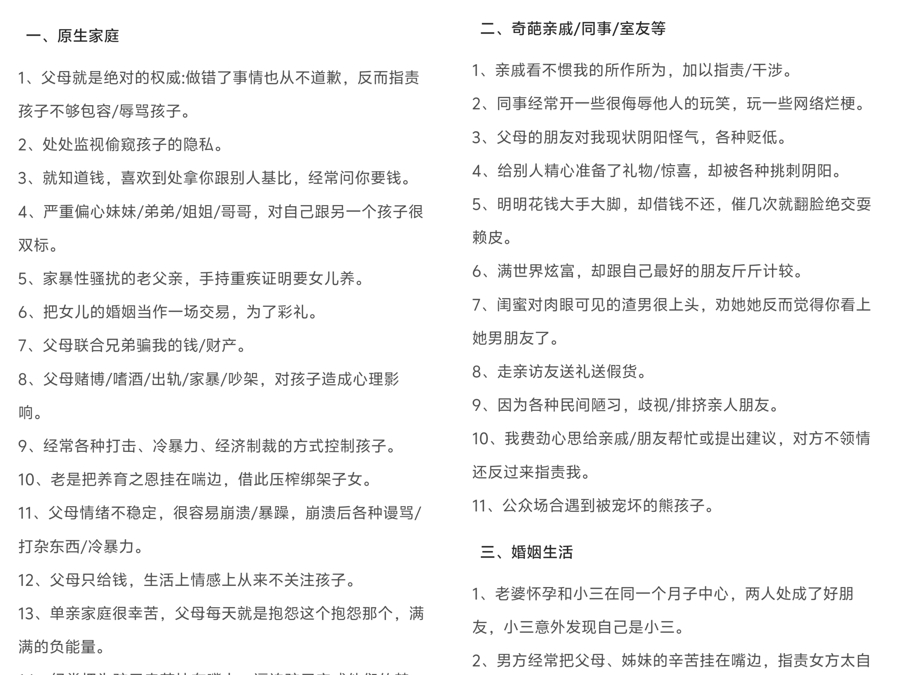

使用AI生成的文字到底什么样?客服说,得自己输入指令才能看到成品。但他们提供参考的“爆款素材”,包括“追妻火葬场套路”“原生家庭缺陷”“奇葩亲戚/同事/室友”等。客服还表示,用AI生成相关文章或视频后,除了发布在社交平台上获得流量分成外,还可以向部分网络文学平台投稿,收入更可观。

记者购买的课程提供的“AI文章爆款主题”(网络截屏)

记者购买的课程提供的“AI文章爆款主题”(网络截屏)

记者又联系到另一名推销AI副业的“导师”,他也毫不讳言地表示:“靠AI赚钱,选题是关键。”为证明自己“经验丰富”,他向记者介绍了几个核心“选题方向”。

“卖惨”是他给的第一个建议。他表示,用AI生成卖惨类话题很简单,常见的“骑手卖惨”是典型话题,“用AI生成骑手遭遇恶劣天气送餐、被客户误解、家庭困难仍坚守岗位等内容,搭配煽情文案,极易引发同情和转发”。他还建议,这类选题可以用“真假参半”的形式体现,“拍一点街头送外卖的场景,就不容易被平台判定为AI生成”。

他又介绍,若是觉得卖惨类话题比较雷同,可以反其道行之——炫富,“别人在发骑手卖惨,你也可以做骑手炫富,用AI生成‘骑手月入三万买豪车’‘跑外卖三年全款买房’等内容,利用反差感制造话题热度。”

“根据热点事件生成‘心灵鸡汤’类型的分析稿件也有市场。”该“导师”说,在这类稿件中,可以用真实事件作为主体,然后用AI生成“治愈”“励志”“煽情”“批判”等不同风格的“心灵鸡汤”,“就是对真实事件进行解读、分析、延伸。”他还建议:“用AI生成文字后,你对着提词器读,看上去是真人解读,效果更好。”

该“导师”称,如果记者购买付费服务,他还能传授如何修改AI生成内容的痕迹、如何判断敏感词规避平台审核等;更进一步,能“介绍企业宣传、自媒体运营的订单,赚钱更多”。

可见,在AI造假牟利上,已经形成了“教程售卖-工具推荐-内容生成-商业接单”的完整灰色链条。

“用魔法打败魔法”

AI生成的虚假内容在网络空间肆意传播,真的处于无人监管的真空地带?答案显然是否定的。

去年9月1日,《人工智能生成合成内容标识办法》正式施行。办法明确规定,所有AI生成合成的文本、图片、视频等内容,必须添加显式标识,确保用户能够清晰辨别内容来源。

记者实测验证发现,主流大模型在生成内容时已初步落实该规定:生成文稿时,结尾会自动标注“本内容包含AI生成部分”;生成图片或视频时,内容角落也会添加半透明的“AI生成”水印。同时,将这类已标注AI生成的内容上传至多个社交平台时,发布界面会跳出弹窗提示:“经检测,该内容含AI生成元素,将按规定展示标识后发布”,强制完成合规标注。

目前,不少社交平台对明显有AI生成痕迹的内容进行强制标注(网络截屏)

目前,不少社交平台对明显有AI生成痕迹的内容进行强制标注(网络截屏)

不过,造假者也在总结“去标识”技巧:文本类内容直接删减末尾的AI标注语句;图片类通过裁剪、拉伸或轻微调色抹去水印,视频类利用剪辑工具剪掉带标识的片段;更进一步,通过调整格式或二次转码的方式,清除文件属性中的AI标记……经过以上处理,部分AI生成内容就能堂而皇之地以“原创”身份发布在社交平台,普通用户难以辨别。

面对这种规避监管的行为,治理之路该如何推进?AI行业从业者尤骑给出的答案是进一步发挥“用魔法打败魔法”的力量,即以AI技术对抗AI造假。他还介绍了一个真实的案例:

近期,外网出现一则以外卖骑手为主角的造假消息。该消息包含文本故事、骑手工作照片及短视频,主题是“外卖平台根据骑手的‘贫穷’程度分派订单,比如向越贫穷的骑手分配配送难度更大、收入更低的订单,因为贫穷的骑手不会拒绝”。当地媒体用大模型的鉴别能力查证该消息后发现,部分大模型认为,该消息的文本由AI生成,但部分大模型认为文字是人工撰写的。不过,大模型在识别消息所用的图片和视频时指出,它们存在肉眼不可见且未被破坏的“AI生成印记”。最终,该消息被判断为AI造假。

尤骑解释,此次鉴别成功的核心在于越来越多的大模型开发者开发出了鉴别工具,能精准捕捉AI生成内容的隐性特征。国内不少科技企业和科研机构也研发出了专门的AI生成内容检测工具。这些工具通过深度分析文本的语义模式、句式规整度、逻辑连贯性,以及图片的光影合理性、人物肢体细节,构建多维度鉴别模型。虽然识别准确率不能达到100%,但有很强的参考价值。

“更进一步,是要让更多的AI生成肉眼不可见的隐藏水印。”尤骑说,隐藏水印不会影响内容视觉效果,而且能抵抗裁剪、调色、转码等常规修改操作。正因此,应推动隐形水印技术成为AI生成工具的标配,从技术层面筑牢造假的第一道防线。

平台能否接入“鉴假”大模型?

在提升技术鉴别能力的同时,也需要平台作为“把关人”,承接鉴别能力的落地。

从调查看,将AI造假作为牟利工具的“AI副业从业者”正在不断探索“反标注”方式,一些主打信息发布、文学创作的平台似乎对AI生成的弊端也后知后觉,使得造假者仍旧能利用平台的奖励机制牟利。

要解决这一问题,恐怕还是“老生常谈”:督促平台夯实主体责任,落实事前审查机制。只不过这一次可以用上技术力量——由平台接入成熟的AI生成内容检测大模型,建立“发布前检测—疑似内容预警—违规内容拦截”的常态化审核流程。

具体而言,对用户上传的文本、图片、视频等内容进行实时检测,直接拦截存在AI造假且未标注的内容,不允许上线;对多次发布违规造假内容的账号,采取限流、禁言直至永久封号的梯度处罚措施。尤其对于“AI副业”培训中高频出现的热点议题,更要强化定向审核,及时清理虚假内容,遏制不良导向传播。

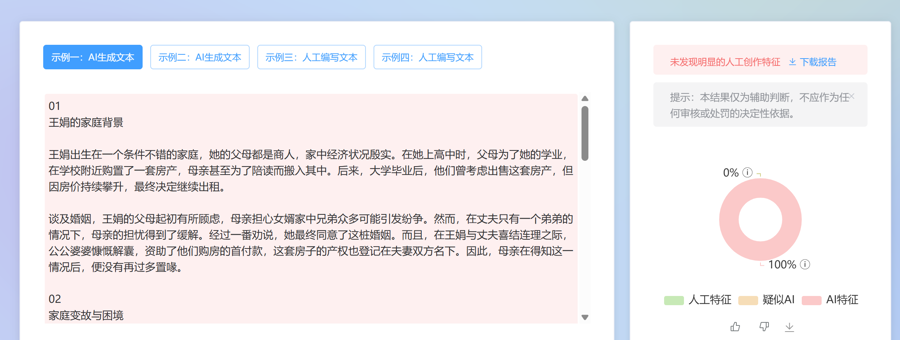

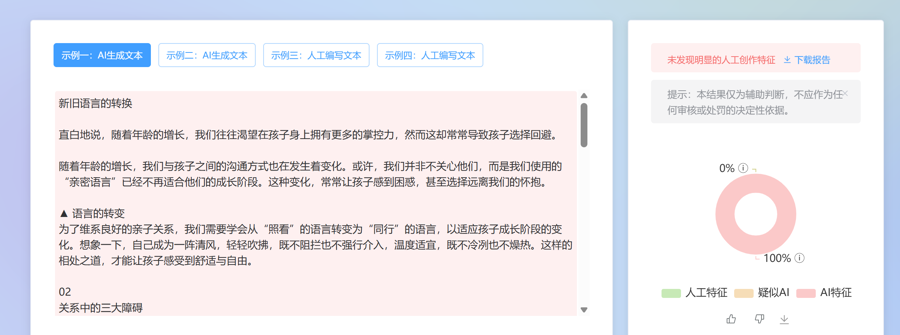

为验证鉴别效果,记者也选取多篇来自不同自媒体的热点事件二创稿件,提交给国内多个大模型进行鉴别。结果显示,有相当一部分“心灵鸡汤”被识别为“没有人工创作痕迹”或“高度疑似AI生成”。再看这些自媒体账号,往往关联到同一个主体。不难推测,它们的始作俑者正是希望用这些AI生成的文章牟利。

记者用国产鉴别大模型测试了部分自媒体发布的“心灵鸡汤”,发现AI浓度很高。业内人士表示,检测结果虽然不能实现100%准确,但有较强的参考性,而且随着技术发展,AI鉴别的准确度也能进一步提高(网络截屏)

记者用国产鉴别大模型测试了部分自媒体发布的“心灵鸡汤”,发现AI浓度很高。业内人士表示,检测结果虽然不能实现100%准确,但有较强的参考性,而且随着技术发展,AI鉴别的准确度也能进一步提高(网络截屏)

试想,如果发布平台提前接入鉴别大模型,在信息发布伊始就将AI生成的内容加以标注,并下架那些涉嫌误导的信息,是不是能从源头减少谣言的传播和扩散呢?

当然,治理AI造假无法仅靠监管和技术,公众的辨别能力同样重要。在信息爆炸时代,面对动辄10万+的网络爆款、看似治愈的心灵鸡汤,公众也要保持理性判断,不盲目相信、不随意转发。如果仅凭情绪共鸣就轻信传播,很可能被AI生成的虚假内容迷惑,陷入更深的信息茧房。

好牛配资提示:文章来自网络,不代表本站观点。